Representation Learning

TL;DR; (짧은 요약)

- Representation Learning 은 좋은 Feature를 학습하기 위해 도입되는 여러 테크닉들을 총칭하며,

물론 labeled data를 활용하여 학습시킬수도 있지만, 대용량의 unlabeled data를 이용하여 self-supervised 방식으로 학습된다

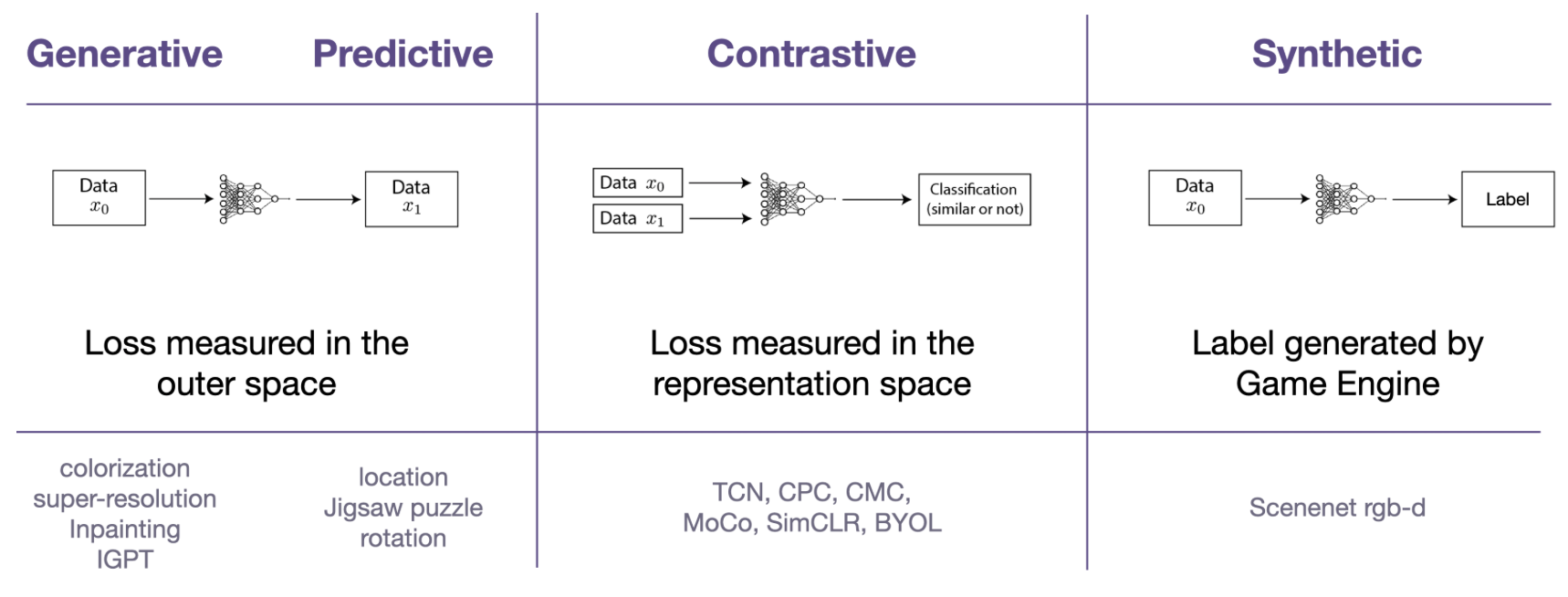

ResNet으로 학습된 가중치의 일부를 고정하고 사용하는것과 같은 방식도 결국 학습된 Repersentation을 이용하는것 - Feature를 학습하는것이 목표이지만 우리가 feature 자체에 supervision을 줄 수 없으므로, 다양한 Task에 대해 학습시키면서 그 와중에 feature가 잘 학습되길 기대하는 것이며 그런 학습 목적들을 Pretext task라고 부른다 (아래 그림 참조)

- Feature가 좋은 표현을 학습하도록 이런저런 제약을 걸어주게 되는데, Outer space에 제약을 걸면 Generative & Predictive Task이고 피쳐들간의 거리가 멀어지게/가까워지게 제약을 바로 걸어주면 Contrastive 라고 한다. 최근에 나온 것들은 대용량의 데이터에 대해 Contrastive 기법을 도입해서 SOTA를 찍은것들이 많다.

연구 트렌드

- 위에서 언급했듯, Contrastive learning을 이용해서 self-supervised representation learning을 하는 것이 대용량의 labeled data를 이용하여 supervised learning을 하는 것보다 하위 태스크로의 확장성도 좋고, high level feature를 잘 학습한다는 것이 밝혀짐

- SimCLR, MoCo 계열은 대체적으로 negative sample을 많이 이용해야 했으며, 데이터가 많이 필요했음

- BYOL 이라는 논문에서 negative sample이 아예 필요 없는 방식을 제안했고, Kaiming He가 SimSiam 이라는 심플한 방법론을 제시함

- 최근에, Barlow Twins나 VICReg라는 방식도 제안됨. 점점 발전하는 SSL, representation learning...

참고문헌

Representation Learning 에 대한 개념 정리 잘 해주신 포스트

- https://nuguziii.github.io/survey/S-004/

- https://nuguziii.github.io/survey/S-005/

- https://nuguziii.github.io/survey/S-006/

Image Feature Learning - supervised, self-supervised, semi-supervised, weakly-supervised

Image Feature Learning 에 대한 개념을 정리한 글입니다.

nuguziii.github.io

다양한 Pretext Task들에 대해 정리 잘 해주신 포스트

Unsupervised Visual Representation Learning Overview: Toward Self-Supervision

Self-Supervised Learning 분야에 대한 전반적인 설명과, Image 인식 분야에 Self-Supervised Learning을 적용시킨 대표적인 논문들을 간단하게 리뷰하였습니다.

hoya012.github.io

SimSiam 논문의 설명 및 정확한 작동 기전을 설명한 논문 리뷰 포스팅

[Paper Review] How Does SimSiam Avoid Collapse Without Negative Samples? A Unified Understanding with Self-supervised Contrastiv

왜 작동하는가? 에 대한 기존 설명을 반박하고, representation vector decomposition, gradient component decomposition 을 통해 de-centering, de-correlation effect 를 확인함.

velog.io

고려대학교의 DMQA 연구실에서 진행한 SSL (Barlow Twins, W-MSE, VICReg) 세미나